14

Jan 2026

- Articles et presse

De la jungle documentaire à la réponse en 10 secondes : comment un agent conversationnel a changé l’accès à l’information dans un projet client

Article écrit par Ayoub Alkarim, Consultant IA & ML Engineer, et Makrem Djebali, Directeur Data et IA.

Dans un monde où l’information se multiplie à vitesse grand V, nous avons souvent le même constat : avoir la donnée n’est pas suffisant — encore faut-il pouvoir la trouver, la comprendre et s’en servir au bon moment. C’est ce défi que nous avons voulu relever en développant un agent conversationnel capable d’accéder à la fois à notre base de connaissances interne et au web, et de restituer des réponses claires, sourcées et immédiatement utilisables.

Ce retour d’expérience est issu d’un projet mené pour un client du secteur de l’assurance, dans un contexte où les équipes faisaient face à une forte pression opérationnelle et à une documentation interne devenue difficile à exploiter au quotidien.

Ce retour d’expérience raconte, pour un public large, pourquoi ce projet a compté, ce qu’il a changé pour les utilisateurs et les équipes, et ce que nous en tirons comme enseignements.

Il illustre aussi très concrètement la façon dont nous concevons les projets IA chez Périclès : partir des usages réels, sécuriser les données, et livrer rapidement des résultats visibles.

Le problème que nous cherchions à résoudre

Avant le déploiement de l’agent, l’accès à l’information ressemblait à une chasse au trésor : documents internes dispersés, procédures versions multiples, et quand il manquait un élément, il fallait lancer des recherches externes — souvent longues pour retrouver l’information manquante et compléter la réponse au client ou le dossier en cours. Les conséquences étaient simples mais lourdes : perte de temps, réponses parfois contradictoires, surcharge des équipes support.

Notre objectif était donc double :

- Raccourcir drastiquement le temps nécessaire pour obtenir une réponse fiable.

- Rendre l’information plus accessible et utilisable par toute personne, quel que soit son niveau technique.

Concrètement, certaines équipes passaient plusieurs minutes, voire plus d’un quart d’heure, à retrouver une procédure ou un modèle de document, avec à la clé des délais supplémentaires pour les clients finaux et une vraie frustration côté opérationnel.

La solution — un agent hybride, simple à utiliser

Plutôt que de concevoir un simple FAQ automatisé, nous avons construit un agent conversationnel hybride : il puise dans notre patrimoine documentaire interne, et complète au besoin par des recherches sur le web. L’utilisateur pose sa question en langage naturel, et l’agent renvoie une réponse structurée, parfois enrichie par des sources externes lorsque c’est pertinent.

Côté expérience, le principe était clair : interaction naturelle, réponse rapide, transparence sur l’origine des informations. Pas d’interface compliquée, juste une conversation utile.

Un exemple typique de requête : “Donne-moi la procédure pour traiter le cas X et le modèle d’e‑mail associé”. L’agent répond avec un résumé des étapes clés, les points d’attention et les liens directs vers les bons documents internes, tout en indiquant s’il s’appuie uniquement sur la base documentaire ou s’il complète avec des sources publiques.

Les briques technologiques (sans entrer dans le laboratoire)

Pour ceux qui aiment savoir un peu ce qu’il y a « sous le capot » — sans jargon — nous avons utilisé des technologies cloud modernes permettant de concilier performance et sécurité. Concrètement :

- le développement s’est appuyé sur le framework Strands d’AWS, qui facilite la coordination et l’orchestration d’agents conversationnels ;

- pour la recherche dans nos connaissances internes, nous avons exploité AWS Bedrock Knowledge Base, une solution conçue pour structurer et retrouver efficacement l’information ;

- pour l’expérience utilisateur temps réel, les réponses de l’agent sont streamées via une API WebSocket, déclenchant une fonction Lambda qui orchestre la génération et l’envoi progressif de la réponse.

Ces choix techniques ont été faits pour une seule raison : offrir une expérience fluide et fiable, sans que l’utilisateur ait à comprendre l’architecture technique.

Un point clé pour le client : aucune donnée sensible n’est envoyée vers des services non maîtrisés. L’architecture a été pensée pour garder le contrôle sur les contenus internes, tout en bénéficiant de la puissance des modèles d’IA générative.

Ce que les utilisateurs ont ressenti

Les retours ont été presque immédiats. Trois aspects sont revenus systématiquement :

- Gains de temps — Les personnes trouvent ce qu’elles cherchent en quelques secondes, au lieu de parcourir plusieurs documents ou d’attendre une réponse du support.

- Confiance — Le fait que l’agent précise si l’information vient de notre base interne ou d’une source publique rassure : on sait d’où vient la réponse.

- Simplicité — Les utilisateurs apprécient l’interaction en langage naturel : ils posent la question comme à un collègue et obtiennent une réponse structurée.

Pour les équipes internes, l’impact est également visible : la charge des demandes routinières a diminué, ce qui a libéré du temps pour des tâches à plus forte valeur ajoutée (analyses complexes, amélioration des services, etc.).

Plusieurs utilisateurs pilotes nous ont indiqué que l’agent était rapidement devenu un “réflexe” : avant d’envoyer un e‑mail ou de créer un ticket, ils passent par l’agent pour vérifier si l’information n’existe pas déjà dans la base.

Impacts concrets et mesurables

Nous avons suivi un petit ensemble d’indicateurs simples pour mesurer l’efficacité : temps moyen de résolution d’une question, taux de satisfaction utilisateur, et volume de requêtes soumis au support humain. Résultats partiels observés après quelques semaines :

- réduction significative du temps moyen de recherche d’information ;

- hausse du taux de satisfaction lors des enquêtes post-interaction ;

- diminution du nombre de tickets support pour les questions basiques.

Sur le périmètre testé, nous avons observé une baisse notable du temps moyen de recherche d’information (de l’ordre de plusieurs dizaines de pourcents) et une réduction sensible des sollicitations de niveau 1 auprès des équipes support. Même si ces chiffres restent à consolider sur une période plus longue, la tendance est très encourageante.

Au-delà des chiffres, un effet qualitatif essentiel est apparu : la valorisation du patrimoine documentaire. Des documents jamais consultés depuis des mois ou des années ont retrouvé une utilité immédiate grâce au moteur de recherche interne et à la mise en contexte par l’agent.

Ce que nous avons appris (et ce que nous ferons différemment)

Quelques enseignements clés tirés du projet :

- La qualité des sources internes compte plus que la sophistication de l’IA. Un bon agent sur du contenu mal structuré ne donnera pas de bons résultats. Investir dans la gouvernance documentaire est indispensable.

- La transparence augmente l’adoption. Indiquer l’origine de l’information (interne vs web) et proposer des liens ou références rend l’outil crédible.

- Expérience en temps réel = sensation de conversation. Le streaming des réponses via WebSocket a transformé la perception : l’agent n’est plus un moteur mais un interlocuteur.

- Itération rapide. Nous avons déployé en petits pas, collecté du feedback et ajusté les réponses, le ton et les sources — cela a maximisé l’adoption.

Nous reviendrons sur certaines parties du catalogue documentaire pour mieux structurer les contenus et améliorer le score de pertinence des réponses.

Si c’était à refaire, nous investirions encore plus tôt sur la préparation des contenus (déduplication, clarification des versions, reformulation en format “FAQ”) afin d’accélérer la montée en qualité de l’agent et de réduire les premières frictions côté utilisateurs.

Limites et précautions

Aucun système n’est parfait. L’agent n’est pas un substitut à l’esprit critique humain : il peut parfois synthétiser des informations complexes de façon trop concise ou manquer de contexte. C’est pourquoi nous avons intégré des garde-fous : validation humaine pour certains types de requêtes sensibles, et mécanismes de feedback pour signaler une réponse insatisfaisante.

Sur le plan de la sécurité et de la conformité, l’accès aux données internes reste contrôlé, et l’architecture a été conçue pour respecter les exigences de confidentialité.

Nous avons également défini quelques règles d’usage claires : l’agent ne doit pas être utilisé pour prendre des décisions juridiques, engager contractuellement l’organisation ou traiter des cas individuels sensibles sans validation humaine. Mieux vaut qu’il dise “je ne sais pas” plutôt qu’il invente une réponse.

Et maintenant ? Les perspectives

Ce projet n’est que le début. Les usages possibles sont nombreux : assistance à l’onboarding des nouveaux arrivants, aide à la décision pour les managers, création de rapports automatisés, ou encore intégration à des outils métiers pour contextualiser des données en direct.

Le fil rouge restera le même : mettre l’information au service des personnes, pas l’inverse. L’agent doit rester simple, utile et digne de confiance.

Chez Périclès, nous voyons ce type d’agent comme une première brique. À partir de ce socle, il devient possible d’imaginer d’autres cas d’usage IA : assistants métier spécialisés, copilotes pour la rédaction de documents, ou encore outils d’analyse augmentée des données de l’organisation.

Conclusion — Une petite révolution quotidienne

Au bout du compte, ce que nous avons construit n’est pas une prouesse technique pour la beauté du code, mais un outil quotidien qui change la vie des utilisateurs : moins de recherches fastidieuses, des réponses plus rapides et plus fiables, et des équipes qui retrouvent du temps pour l’innovation.

Ce type de projet montre que, quand on combine technologie moderne (frameworks cloud, bases de connaissances structurées, streaming en temps réel) et focus sur l’expérience humaine, on obtient quelque chose de puissant : un assistant qui transforme une bibliothèque d’informations en connaissance réellement accessible. Et ça, pour les personnes qui l’utilisent chaque jour, c’est une petite révolution.

C’est aussi une démonstration très concrète de ce que peuvent apporter les projets IA bien cadrés : partir d’un irritant métier très simple (“je ne retrouve pas l’info”) et, en quelques itérations, livrer un service qui améliore réellement le quotidien des équipes. C’est exactement ce que nous cherchons à faire sur nos projets IA chez Périclès.

Envie d’en savoir plus sur Périclès Group ?

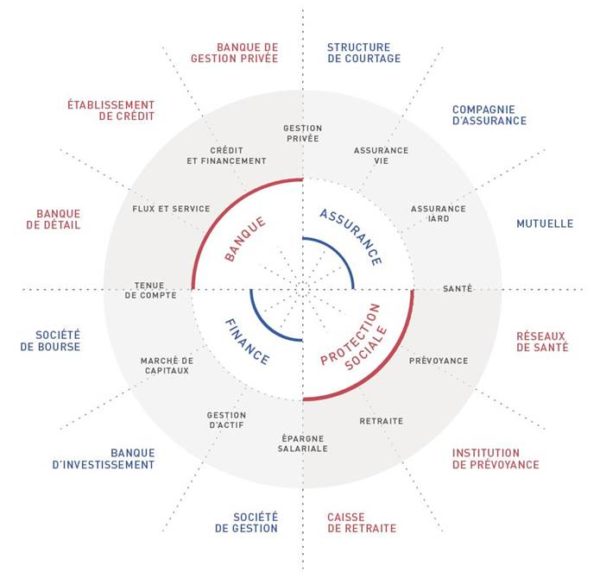

Spécialisé dans les domaines de la Banque, de la Finance, de l’Assurance et de la Protection Sociale, notre Cabinet place l’expertise au cœur de son savoir-faire. Nos équipes interviennent à la fois sur les phases stratégiques, organisationnelles, de mise en œuvre et s’adaptent aux spécificités de chaque projet. Nos antennes françaises, luxembourgeoises et anglaises seront ravies d’échanger avec vous autour de vos besoins en assurance, finance et actuariat. Pour nous contacter, cliquez ici.

Autres actualités

11

Fév 2026

16

Jan 2026

12

Jan 2026

22

Déc 2025

- Articles et presse